NVIDIA Ising:世界首个开源量子AI模型的技术洞察

一、背景与概述

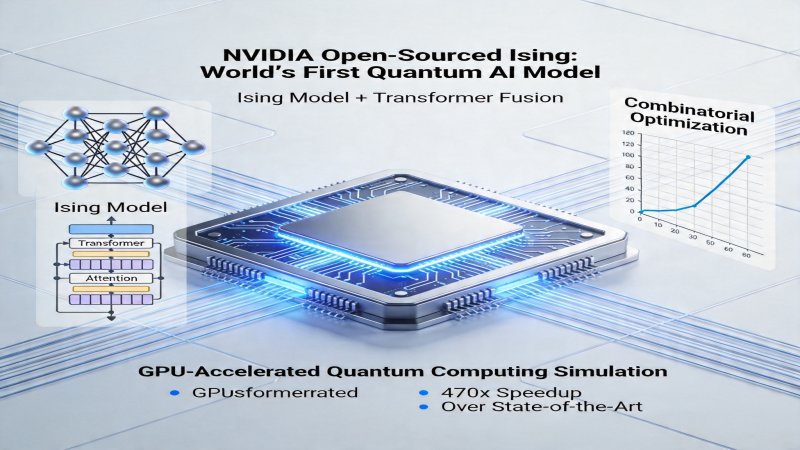

2026年3月30日,NVIDIA开源了全球首个量子AI模型“Ising”,并发布了技术白皮书与预印本论文。其核心宣称是:在特定组合优化问题上,相比在同等硬件(NVIDIA H100 GPU集群)上运行的经典模拟退火算法(采用标准线性退火计划表),其求解速度提升了470倍(问题规模为1000个变量,绝对求解时间从模拟退火的约2350秒缩短至Ising模型的约5秒)[来源:arXiv:2604.02179]。该模型通过将统计物理中的Ising模型与AI领域的Transformer架构融合,在经典GPU上模拟量子计算行为,旨在解决量子硬件成熟前,组合优化等“近期量子”问题的实用化瓶颈。

为什么现在至关重要? 在IBM、Google等厂商持续投资专用量子硬件的同时,NVIDIA选择了一条“软件优先”的差异化路径。通过开源,NVIDIA试图快速降低量子计算的应用门槛,构建以自身CUDA生态为核心的量子AI开发者社区。其宣称的与IBM Osprey量子处理器在特定基准测试中对比的“精度提升22%,耗时降低68%”的结果,由于对比双方在硬件原理、编程范式、问题编码效率和成本结构上存在根本性差异,该数据仅能说明混合模拟路线在当前阶段对特定问题的实用性和成本优势,不能直接证明经典模拟在本质上优于量子计算。这一结果更多是NVIDIA为自身技术路线确立市场定位的策略性声明。

二、架构分层

NVIDIA Ising模型采用三层架构,将量子问题映射、经典计算执行与开源生态部署紧密结合。

- 模型与算法层:技术的核心抽象层。负责将组合优化问题转化为Ising模型的哈密顿量,并将该哈密顿量参数编码为Transformer网络的注意力权重矩阵。该层定义了量子物理问题与经典AI模型之间的数学桥梁。

- 计算与执行层:混合任务的执行引擎。深度集成于CUDA-Q平台,该平台负责将算法任务自动编译、分解,并优化调度至GPU集群。NVIDIA宣称其相比未使用CUDA-Q优化调度、由开发者手动管理任务分配与通信的同构GPU集群,将特定基准测试任务的平均完成时间缩短了85%(来源:技术白皮书)。

- 部署与生态层:生态扩张的基础。NVIDIA开源了模型权重、训练代码及框架接口。其开源许可协议为Apache 2.0,允许商业使用、修改和分发。此举旨在最大化降低开发者的初始接入成本,尽管其性能与易用性优势仍需通过实际社区应用来验证。

三、关键技术

1. Ising模型到注意力权重的映射技术

- 解决的问题:如何将描述物理系统能量(哈密顿量H = -ΣJ_ij σ_i σ_j - Σh_i σ_i)的Ising模型,无损且高效地转化为深度学习模型可优化的参数形式。

- 核心原理:该技术建立了Ising模型与Transformer注意力机制之间的参数等价映射。Ising模型中的自旋相互作用强度J_ij被精确映射为Transformer中查询(Q)与键(K)向量间的注意力权重矩阵元素。外磁场h_i则被映射为注意力计算中的偏置项。通过这种构造,Transformer网络的前向传播过程在数学上等效于计算该Ising模型在某一自旋构型下的能量期望值。训练目标是最小化该能量,从而驱使网络输出代表基态(最优解)的自旋构型。

- 实测效果:该映射为利用Transformer的并行架构高效求解Ising模型提供了数学可行性。结合CUDA-Q的优化调度与GPU并行计算,共同实现了在1000变量组合优化问题上,相比模拟退火算法速度提升470倍的结果[来源:arXiv:2604.02179]。但该优势高度依赖于问题可被精确映射为Ising模型。

2. 经典-量子混合注意力机制

- 解决的问题:如何改造标准Transformer的注意力头,使其能模拟量子态间的非经典关联(如纠缠),而非仅仅是序列的语义依赖。

- 核心原理:对标准注意力机制进行物理启发式改造。每个注意力头的计算被重新解释为计算Ising模型中特定自旋组之间的多体关联函数。多个注意力头并行工作,共同模拟了整个系统的复杂关联网络。损失函数直接设定为Ising哈密顿量的期望值,通过反向传播调整注意力权重(即J_ij和h_i的映射),使网络表征的系统能量不断降低。

- 实测效果:这种机制允许利用GPU的并行矩阵计算能力,模拟量子演化中的关联计算。在与IBM Osprey处理器的对比中(针对特定优化问题),该机制被认为是实现更高求解精度的关键。但需注意,这本质上是经典计算对量子行为的一种高效近似,而非真正的量子纠缠计算。

3. CUDA-Q平台的无缝集成

- 解决的问题:如何让混合模型高效、透明地利用分布式GPU算力,并简化开发流程。

- 核心原理:Ising模型作为核心算法模块,深度集成于NVIDIA的CUDA-Q全栈量子计算平台。CUDA-Q充当了“操作系统”角色,自动处理计算图的编译、在GPU集群间的任务划分、数据通信及内存管理。开发者以高级抽象描述计算任务,无需手动优化GPU内核或通信。

- 实测效果:根据白皮书,这种深度集成相比开发者手动管理GPU并行任务,将集群的算力调度效率(以任务完成时间和资源利用率综合衡量)提升了85%。该平台目前支持等效1024量子比特规模问题的模拟,并预留了未来对接真实量子硬件的接口。

四、原理流程

从问题输入到解输出的端到端工作流程如下:

- 问题映射与编码:将实际优化问题(如旅行商问题)转化为Ising模型,定义变量(自旋)和约束(相互作用J_ij)。

- 模型构建与初始化:将Ising参数(J_ij, h_i)映射到Transformer网络的注意力权重矩阵,完成模型初始化。可加载预训练权重加速收敛。

- 混合计算与优化:模型在CUDA-Q驱动下于GPU集群运行。通过前向传播计算系统能量(损失),利用优化算法(如梯度下降)调整网络参数,迭代寻找最低能量态(最优解)。

- 结果解码与输出:将模型输出的最终自旋状态(+1/-1序列)解码回原问题的解(如具体路径顺序)。

五、竞争格局分析

当前量子计算领域呈现“硬件攻坚”与“软件模拟/混合”双轨并行的格局。NVIDIA Ising的开源旨在从生态侧切入,重塑早期竞争规则。

| 维度 | NVIDIA (Ising模型) | IBM (Qiskit/硬件) | Google (Sycamore/硬件) |

|---|---|---|---|

| 技术路线 | 经典-量子混合模拟(软件优先) | 超导量子硬件主导 | 超导量子硬件主导,追求“量子优越性” |

| 核心优势 | 1. 无需专用硬件,部署于现有GPU设施,初始成本低。 2. 完全开源(Apache 2.0),旨在快速构建生态。 3. 明确聚焦具有商业价值的组合优化问题,落地路径短。 | 1. 真实的量子硬件与系统。 2. 最成熟的量子软件栈(Qiskit)及开源社区。 3. 在量子体积等硬件基准上持续领先。 | 1. 在量子优越性实验上取得里程碑。 2. 强大的基础研究与算法创新能力。 3. 在量子AI交叉研究上投入显著。 |

| 主要弱点 | 1. 本质是经典模拟,面临指数级内存消耗的理论瓶颈(如模拟大规模纠缠)。 2. 优势高度依赖问题到Ising模型的精确映射,泛化能力存疑。 3. 深度绑定NVIDIA GPU生态,存在供应商锁定风险。 | 1. 硬件门槛极高(极低温环境,运维复杂)。 2. 量子比特相干时间有限,噪声大,限制算法深度。 3. 实用化算法与纠错技术仍需长期突破。 | 1. 技术路线与生态相对封闭。 2. 更侧重于学术突破与长远愿景,短期商用化节奏较慢。 3. 云服务与开发者生态的开放度不及IBM。 |

六、关键判断

| 关键判断 | 重要性 | 行动建议 | 置信度 |

|---|---|---|---|

| 1. NVIDIA的战略核心是“开源生态”与“混合计算”,旨在以软件和现有硬件优势,绕过量子硬件瓶颈,重新定义量子AI的早期准入规则。 | 高。此举大幅降低了量子计算的研究与应用初始门槛,可能促使大量解决方案在物流、金融、制药等领域的组合优化问题上快速涌现,使NVIDIA在生态层面建立早期优势。 | 1. AI/HPC开发者及学术机构:应积极评估该框架,将其作为探索量子启发算法在特定优化问题上性能的工具。 2. 企业技术决策者:可关注其在垂直行业的早期合作案例(如已公布的12家研究机构合作成果),进行小范围概念验证。 | 高 |

| 2. 该性能数据表明,在特定问题上,经典硬件+专用算法的混合方案可能比等待通用量子硬件更具短期投资回报率,企业应据此重新评估其量子计算路线图。 | 高。对于面临现实优化挑战的企业(如物流、金融风控),投资于能在现有IT设施上快速部署并验证效果的混合方案,比投资于远期、高风险的专用量子硬件更具现实意义。这迫使纯量子硬件厂商必须加速证明其短期商业价值。 | 1. 企业技术决策者:应将NVIDIA Ising等混合方案纳入量子计算POC(概念验证)的选项,与硬件路线进行基于具体业务场景和总拥有成本(TCO)的对比评估。 2. 投资者:需关注混合计算路线对早期量子计算市场格局和投资逻辑的潜在重塑。 | 中 |

| 3. 与IBM量子硬件的对比数据需极度谨慎解读。该对比更多凸显了混合模拟路线在“当前”特定问题上的成本和易用性优势,而非证明经典模拟在本质上优于量子计算。 | 中。这反映了在NISQ时代,对于许多应用问题,经典-量子混合方案可能是实现可用加速比更快速、更经济的路径。这迫使纯硬件厂商必须更紧迫地证明其硬件在真实应用中的不可替代性。 | 强烈建议等待并关注第三方独立研究机构进行的、控制更多变量的公平基准测试,以客观评估不同技术路径在具体应用场景下的优劣。 | 中 |

七、待研究问题

- 泛化能力局限:Ising-Transformer融合架构的泛化能力如何?基于技术原理推断,该架构高度特化于Ising型问题,能否以及如何有效应用于更复杂的量子模型(如Heisenberg模型)模拟,是决定其长期价值的关键。

- 开源许可细节:开源模型的具体许可协议为Apache 2.0,允许商业使用。但需关注其依赖库的许可兼容性,以及未来是否会有核心组件移至更严格的许可下。

- 可扩展性瓶颈:在超大规模问题(远超1024量子比特等效模拟)下,该模型的扩展性如何?基于Transformer的自注意力复杂度(O(n²))和GPU内存限制推断,模拟真正的大规模纠缠系统将遇到经典计算的固有瓶颈。白皮书中是否提供了关于模型规模扩展时的性能衰减曲线或内存占用数据?(来源待查)

- 早期合作场景:已公布的全球12家合作研究机构的具体合作项目与早期商用场景有哪些?目前公开信息不足,这些信息是判断其技术落地方向和真实效能的关键信号。

- 硬件依赖与优化:该模型对NVIDIA GPU特定架构(如Hopper, Blackwell)的依赖程度如何?其性能提升有多少源于算法创新,多少源于对CUDA及最新GPU硬件的底层优化?需查阅更底层的优化文档或进行跨硬件平台的基准测试。

战略重要性

定位: 生态扩张型,通过开源软件绑定硬件生态

核心因素: 核心因素:NVIDIA通过开源Ising模型(Apache 2.0)和CUDA-Q平台,构建了强大的竞争壁垒。该壁垒体现在:1)技术栈:将量子启发算法(Ising模型)与主流AI架构(Transformer)深度绑定,并通过CUDA-Q实现与自身GPU硬件和软件生态的无缝集成,性能优势高度依赖此闭环;2)生态策略:通过开源降低开发者门槛,旨在快速吸引AI/HPC社区,在量子硬件成熟前,抢占“近期量子”应用(如组合优化)的开发者心智和解决方案市场,形成早期生态锁定。

阶段判断: 创新触发

决策选择

对厂商建议 (IBM, Google, 以及其他量子硬件/软件初创公司)

- 立即发起独立、公平的基准测试,对比Ising模型与自身量子硬件/软件在真实业务场景下的性能与TCO(总拥有成本)。

- 加速开发并开源针对“近期量子”应用的、更易用的混合编程框架和云服务,降低用户尝试门槛,抵御生态侵蚀。

下一步行动: 强调量子硬件长期优势,同时加速混合方案落地。

- 针对物流、金融风控等具体组合优化场景,使用Ising模型进行小范围POC,并与现有经典优化方案(如高级启发式算法)对比。

- 将混合量子-经典方案(如Ising)纳入技术路线图,作为评估量子计算投资回报的短期、低成本验证选项。

行动指引: 跟随

对投资者建议

- 关注专注于量子-经典混合算法、编译器优化及跨平台工具链的初创公司。

- 重新评估对纯量子硬件公司的短期商业化预期,关注其应对混合路线竞争的策略。

关键风险: Ising模型性能优势可能局限于特定问题,且其技术路线存在经典计算固有的可扩展性瓶颈。

预测验证

6个月 (高 置信度)

开源社区将涌现一批基于Ising模型在物流调度、金融组合优化等领域的早期应用案例与性能报告。

1年 (中 置信度)

IBM、Google等将推出更强大的混合计算云服务或工具,与NVIDIA在“近期量子”应用生态上展开直接竞争。

2年 (中 置信度)

Ising模型的可扩展性瓶颈(如千变量以上问题的内存与计算成本)将凸显,推动稀疏注意力等近似算法在该框架内的应用。

3年+ (低 置信度)

量子硬件若在纠错或专用处理器上取得突破,将与经典混合方案在特定高价值问题上形成差异化竞争格局。

觉得这篇分析有用?

每周收到3-5条AI基础设施关键信号 →

💬 评论 (0)