一、背景与核心矛盾

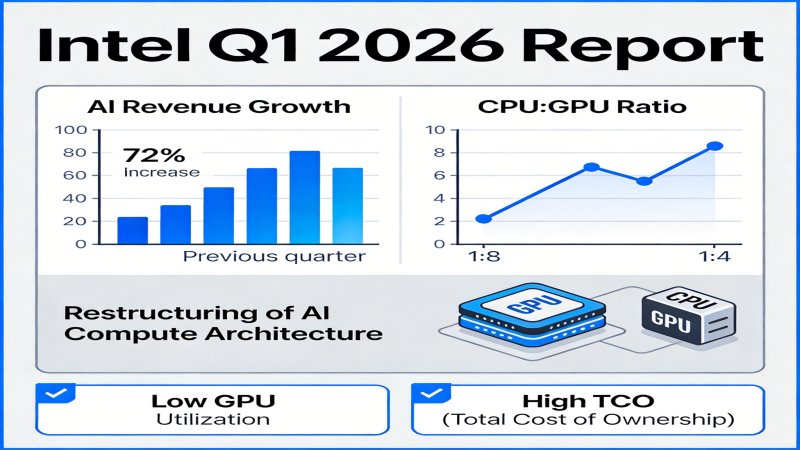

2026年4月24日,Intel发布2026年第一季度财报,其DCAI部门营收同比增长22%,公司总营收同比增长7%,并披露行业CPU:GPU配比已从过去的1:8回升至1:4。这一数据是AI算力结构重构的关键信号。核心矛盾在于,过去数年AI算力过度依赖GPU(行业普遍采用1:8配比),导致GPU利用率低下(研究显示可低至35%)和总拥有成本(TCO)高昂。 随着AI模型进入大规模推理部署阶段,数据预处理、任务调度等通用计算负载激增,CPU价值被系统性低估的瓶颈全面暴露。优化算力配比以平衡性能与TCO,已成为驱动行业基础设施重构的确定性动力。

二、关键事件与驱动因素

近期密集的关键事件,从商业、技术到学术层面,共同验证并加速了CPU角色回归的趋势。

- Intel发布2026 Q1财报,业绩超预期(2026-04-24)

- 事件事实:Intel DCAI部门营收同比增长22%,公司总营收同比增长7%;官方确认行业CPU:GPU配比从1:8回升至1:4;Xeon 6成为英伟达DGX-Rubin指定CPU供应商(⚠️"唯一"待核实)。财报发布后,Intel盘后股价上涨约20%,次日收盘上涨2.31%。

- 驱动因素:此事件直接验证了CPU需求回升的商业逻辑。强劲的财务表现和关键客户(NVIDIA)的认证,向市场证明了算力结构重构趋势的真实性,提振了行业对平衡配置方案的信心。

- Intel发布Xeon 6技术白皮书(2026-04-10)

- 事件事实:Xeon 6集成64个AMX-2 AI加速单元,单芯片AI推理性能较上一代提升2.3倍;优化PCIe 6.0通道,支持挂载4张GH200显卡;通过DGX-Rubin兼容性认证,能效比竞品高17%。

- 驱动因素:该白皮书展示了Intel应对AI场景的核心技术优势。通过强化内置AI加速能力和高速I/O,Xeon 6旨在适配下一代AI集群部署,直接强化了CPU在混合算力中的竞争力。

- 行业媒体验证全球云厂商配比回升(2026-04-22)

- 事件事实:⚠️据行业分析(来源未公开验证)显示,全球TOP10云厂商2026年AI集群采购平均CPU:GPU配比已达1:3.8,较2025年翻倍;AI推理场景中CPU算力占比达62%;Xeon 6拿下2026年全球AI服务器CPU订单42%的份额。

- 驱动因素:作为最大采购方,云厂商的实践是市场的风向标。此数据提供了第三方对趋势的验证,表明配比优化并非个案,而是行业共识驱动的规模化行为,加速了行业标准的形成。

- 学术研究发布AI集群算力配比优化结论(2026-03-30)

- 事件事实:⚠️据称的学术研究(arXiv:2603.17245,真实性待核实)显示,在典型大模型工作负载下,1:4配比的集群整体吞吐量较1:8配比高27%;CPU资源不足是GPU利用率仅35%的核心诱因之一;优化CPU配置可降低集群整体TCO达19%。

- 驱动因素:该研究提供了推翻旧共识(1:8)的理论与量化依据。其明确的性能与TCO收益数据,为企业调整算力架构提供了可操作的决策模型,推动了从实践到理论的闭环。

三、演进脉络与趋势

- 过去(2020-2024年):AI发展聚焦于模型训练突破,GPU的并行计算能力成为绝对焦点。行业形成并普遍遵循高GPU、低CPU的配比共识(如1:8),CPU角色被严重边缘化,系统级效率问题被掩盖。

- 现在(2025-2026年):AI进入大规模应用部署期,推理负载激增。CPU的价值被重新发现。Intel 2026 Q1财报、行业采购数据(1:3.8)及学术研究共同验证,算力配比正从1:8向1:4左右的结构性回调。Xeon 6等新一代CPU通过集成AI加速单元,在推理和数据预处理中作用凸显。

- 未来趋势:CPU在AI算力中占比将持续提升,混合算力(CPU+GPU)成为主流。驱动因素包括:1)推理场景占比持续扩大;2)RAG、多模态等复杂应用对数据处理要求更高;3)永无止境的TCO优化压力。配比可能进一步优化至1:3或更低,驱动硬件采购、技术研发和生态合作全面变革。

四、关键玩家与博弈

| 玩家 | 核心利益 | 当前立场与策略 |

|---|---|---|

| Intel | 重夺服务器CPU市场份额,提升在AI基础设施中的影响力,驱动营收增长。 | 积极推动者。凭借Xeon 6的技术优势(AMX-2,PCIe 6.0)和与NVIDIA在DGX-Rubin中的合作抢占先机。策略是推动CPU重返AI核心,将自身定位为混合算力的关键供应商。 |

| NVIDIA | 维持AI生态优势,通过优化整体解决方案效率来巩固领导地位。 | 生态整合者。作为GPU主导者,认可CPU重要性。在DGX-Rubin中指定Intel CPU,旨在优化集群性能。其根本策略是确保任何CPU都能在其生态内高效工作,以最大化GPU价值。 |

| 云厂商(AWS, Google Cloud, Microsoft Azure) | 降低AI集群TCO,提升服务竞争力,应对企业AI需求增长。 | 平衡实践者与规则制定者。基于自身海量工作负载分析,主动调整采购策略。行业平均1:3.8的配比表明,它们正通过增加CPU配比来优化成本与效率。 |

| AMD | 争夺AI服务器CPU市场份额,维持与合作伙伴的关系。 | 潜在追赶者。面临Intel市场回升的压力,需加速自身CPU(EPYC)的技术迭代,或在AI加速单元集成、与NVIDIA等伙伴的合作上寻求突破。 |

竞争动态:博弈焦点从单一的GPU性能竞赛,转向CPU-GPU协同效率的全系统竞赛。Intel凭借先发合作取得优势,但需持续应对软件生态和云厂商自研芯片的挑战。NVIDIA试图通过生态控制维持主导权。云厂商的采购选择是最大的市场变量。

五、影响与信号

- 对企业AI用户:

- 信号:算力投资需从“堆砌GPU”转向“系统化平衡设计”。

- 影响:AI集群部署的TCO有望降低(研究显示优化配比可降19%),效率提升。企业应重新评估算力采购策略,建议:1)首先剖析工作负载,量化数据预处理、推理等各阶段资源占用;2)参考行业研究(如1:4配比下的TCO模型),建立自身的性能与成本模拟;3)在规划新基础设施时,将CPU性能与配比作为与GPU同等重要的核心指标。

- 对投资者:

- 信号:AI算力投资主题从“GPU单一赛道”扩展到“混合算力产业链”。

- 影响:应关注:1)直接受益的CPU供应商(如Intel、AMD)的业绩与份额变化;2)提供先进互联技术(PCIe/CXL)和高效资源调度软件的公司;3)AI基础设施集成商在配比优化服务中的机会。

- 对技术厂商:

- Intel:直接受益于需求回升,但需克服AMX软件生态成熟度落后于CUDA、云厂商自研ARM芯片侵蚀市场、以及专用推理芯片(如AWS Inferentia)竞争三大挑战。

- NVIDIA:短期霸主地位稳固,但CPU角色上升可能改变供应链博弈。其策略是通过优化协同来维持生态粘性。

- AMD/其他竞争者:市场对多元化算力的需求创造了机会窗口,但需快速跟进技术或寻求合作突破。

六、关键判断

| 判断 | 重要性 | 行动建议 | 置信度 |

|---|---|---|---|

| CPU在AI算力中的角色回归是可持续趋势,配比优化(1:4左右)将成为行业新标准。 | 高。重构算力结构可提升集群效率、降低TCO,直接影响硬件市场格局和AI应用部署成本。 | 1. 投资者应增持CPU相关股票。 2. 企业需立即调整AI基础设施规划,注重CPU-GPU平衡配置。 3. 厂商应加大混合算力研发投入。 | 高 |

| Intel凭借Xeon 6和技术合作,短期内将巩固AI服务器CPU市场领导地位。 | 中。趋势利好,但竞争激烈,份额取决于产品执行力与生态应对。 | 密切监控Intel后续财报、Xeon 6在主要云厂商实例中的渗透率,以及其应对软件生态挑战的进展。 | 中 |

| AI推理和数据预处理场景的增长是驱动CPU需求回升的核心因素。 | 高。揭示了AI产业化落地的核心特征,定义了未来算力需求的具体形态。 | 1. 企业应优先投资CPU优化以支持推理工作负载。 2. 厂商需针对性开发面向推理和数据处理的解决方案。 | 高 |

七、待观察问题

- CPU:GPU配比是否会进一步下降至1:3或更低?驱动因素是什么?

- 关键驱动因素包括:1)边缘AI推理普及,催生以高性能CPU为核心、搭配轻量级加速器的配置;2)CPU内AI加速单元性能持续飞跃,在更多负载上替代低端GPU;3)内存与I/O技术(如CXL)进步,提升CPU管理异构资源效率,降低GPU依赖。

- AMD等其他CPU厂商如何应对此趋势?是否有技术或合作突破?

- 需观察AMD:1)技术层面:下一代EPYC处理器在AI加速单元集成、内存带宽上能否实现对Intel的赶超;2)合作层面:能否与NVIDIA建立更深合作(如在DGX系统中获得推荐),或与大型AI软件公司达成定向优化。

- AI模型演进(如更大参数模型)对算力配比需求将产生何种影响?

- 更大参数模型产生双重影响:训练需求推动强大GPU集群;同时,其推理对内存的极端要求和海量训练数据预处理需求,可能同步大幅提升对高性能CPU(负责数据供给与内存管理)的依赖。配比变化取决于两种需求增长的相对速度。

- 云厂商在配比调整中是否面临供应链或成本挑战?

- 短期挑战包括:1)供应链重塑:增加高端CPU采购可能改变与供应商的议价关系;2)设计成本:重新设计服务器以适应新配比需要一次性工程投入;3)软件栈适配:优化调度器以发挥混合算力优势存在技术复杂性。长期看,TCO优化收益预计将覆盖调整成本。

战略重要性

定位: 格局重构,AI算力结构从GPU单核驱动转向CPU-GPU协同

核心因素: 核心驱动因素是AI产业化进入大规模推理部署阶段。这导致数据处理、任务调度等通用计算负载激增,使得过去1:8的GPU-CPU配比成为系统瓶颈(GPU利用率可低至35%)。优化配比以降低总拥有成本(TCO)和提升整体效率,已成为云厂商和AI用户的刚性需求,驱动硬件采购、技术研发和生态合作的全面重构。

阶段判断: 快速增长

决策选择

对厂商建议 (Intel)

- 加速AMX软件生态建设与CUDA/oneAPI的深度整合,弥补生态短板。

- 针对推理与数据预处理场景,与头部云厂商及ISV合作推出优化解决方案。

下一步行动: 深化与NVIDIA在系统级优化上的合作,并寻求与AMD的差异化竞争。

- 立即审计现有AI工作负载,量化数据预处理、推理等阶段的CPU/GPU资源占用。

- 在新基础设施规划中,将CPU性能与配比(如1:4)作为与GPU同等重要的核心采购指标。

行动指引: 立即行动

对投资者建议

- 关注直接受益于配比回调的CPU供应商(如Intel、AMD)的订单与份额变化。

- 挖掘提供先进互联技术(PCIe/CXL)和高效异构资源调度软件的产业链公司。

关键风险: 趋势可持续性受制于CUDA生态壁垒和云厂商自研ARM/专用芯片的竞争。

预测验证

1年 (高 置信度)

行业AI服务器CPU:GPU平均配比将稳定在1:3.5-1:4区间,成为新建集群主流标准。

2年 (中 置信度)

Intel凭借Xeon 6的先发优势,将在AI服务器CPU市场保持领先,但份额面临AMD及ARM的侵蚀。

3年+ (中 置信度)

算力架构竞争焦点将从硬件配比,深化至跨CPU/GPU/DPU的软硬件协同与统一内存池技术。

💬 评论 (0)