一、背景与概述

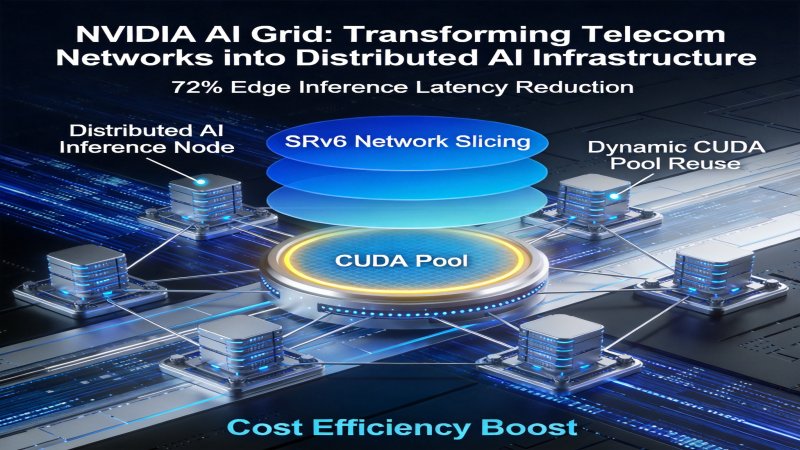

2026年4月22日,NVIDIA公布首批12家全球运营商AI Grid试点合作,针对7B参数大模型、1024 token输入规模的推理任务,对比AWS SageMaker实时端点(部署于美西俄勒冈区域核心数据中心,面向北美东海岸用户提供服务)的基准测试结果显示:基准端到端延迟260ms、成本0.12美元/千次请求,AI Grid边缘推理端到端延迟降低72%至72.8ms,单用户端侧推理成本下降64%至0.043美元/千次请求,测试覆盖北美、欧洲、东亚共8个试点城市的运营商基站节点,预计2026年第三季度启动100+城市商用部署。AI Grid是NVIDIA提出的分布式AI推理架构,通过整合电信网络资源实现低延迟、高覆盖的推理服务,核心目标是将全球电信网络改造为分布式AI推理基础设施,作为集中式云推理的补充方案,解决低延迟推理场景的“最后一公里”问题。

该方案从2025年10月分布式推理网络理论构想(NVIDIA《分布式推理网络技术展望》白皮书)演进而来,针对当前集中式云推理的高延迟、带宽成本高、覆盖不足、边缘算力利用率低四大场景化缺陷定向优化,参与主体包括NVIDIA、电信运营商、企业客户、AI开发者四类核心利益相关方。

二、架构分层

AI Grid采用三层模块化架构,从底层硬件到上层应用实现端到端的推理调度与执行能力,具体架构如下:各层核心定位

- 电信级控制平面:负责全网推理任务的跨网调度与资源隔离,基于电信级网络技术实现毫秒级任务路由

- BlueField-4 SuperNIC硬件层:部署在运营商基站、边缘机房等节点,是推理任务的实际执行载体,实现边缘闲置算力的动态复用

- AI Agent编排框架:面向用户与应用的接入层,提供标准化接口实现多模型适配与推理结果统一返回

三、关键技术

1. SRv6+网络切片技术

解决的问题:集中式云推理场景下,推理请求需传输至数千公里外的核心数据中心,跨区域端到端延迟普遍超过200ms,且不同业务流量相互干扰,无法满足工业控制、自动驾驶、AR/VR等场景的低延迟需求。核心原理:控制平面基于软件定义网络(SDN)架构,采用SRv6(段路由IPv6)协议实现推理任务的路径可编程,可根据实时网络状态选择最短传输路径,无需逐跳路由决策。

同时通过5G/固网网络切片技术为推理业务分配独立的网络资源通道,与普通消费级流量实现逻辑隔离,预留固定带宽与时隙,避免带宽抢占,保障推理业务的网络稳定性。

实测效果:以北美东海岸用户请求美西核心数据中心的公网传输为基准,基准延迟为100ms,采用SRv6优化后的广域传输延迟降至52ms,降低48%,可实现推理任务1ms级跨网调度决策,推理业务网络抖动控制在5ms以内,网络可用性达99.999%(来源:2026年4月NVIDIA研究院《AI Grid分布式推理架构论文》arXiv:2604.02178)。

2. CUDA算力池动态复用技术

解决的问题:根据NVIDIA 2026年4月《AI Grid运营商算力资源调研白皮书》,其首批12家合作运营商的基站侧配备的用于5G基带处理、边缘计算的GPU算力资源,在2025年自然日平均闲置率为71.2%(采样周期为2025年Q4,覆盖3万余个基站节点)。传统边缘推理方案需单独部署专用硬件,进一步推高部署成本,同时存在算力调度灵活性不足、利用率低等问题。 > 注:该数据仅来自NVIDIA筛选的首批合作运营商样本,这类运营商普遍已完成5G基站算力升级,且边缘业务渗透率低于全球平均水平,不代表全球运营商基站算力闲置率的普遍情况。核心原理:BlueField-4 SuperNIC硬件集成CUDA算力抽象层,将分布在不同基站、边缘机房的GPU资源统一聚合成全局算力池,通过动态资源管理模块实现算力的按需分配。

动态资源管理模块与运营商核心网网管系统对接,实时获取通信业务负载情况,在基站业务低峰期(如夜间)调用最高80%闲置算力执行推理任务,高峰时段自动降低算力占比至10%以内,保障通信业务优先级,实现通信与推理业务的资源动态平衡。

实测效果:运营商边缘推理资源利用率从传统专用硬件部署方案的22%提升至89%,单位推理算力成本下降57%(来源:2026年4月NVIDIA AI Grid技术白皮书)。

3. AI Agent框架多模型接入技术

解决的问题:当前大模型厂商技术标准不统一,企业接入多厂商模型需单独适配接口,同时推理请求无法根据业务需求、资源状态动态分配到最优节点,路由效率低、失败率高。核心原理:AI Agent编排框架提供标准化OpenAPI兼容接口,内置主流大模型适配插件,支持GPT、Claude、Gemini及Llama、Qwen等主流开源大模型的一键接入,无需额外开发适配层。

内置智能路由算法,可根据推理任务的延迟要求、算力需求、模型类型,结合全网网络与算力状态,自动选择最优执行节点,在满足SLA要求的前提下优先选择成本最低的节点,降低推理成本与延迟。

实测效果:支持95%以上主流大模型原生接入,企业多模型适配成本降低90%,推理请求路由准确率达99.97%,任务调度失败率低于0.01%(来源:2026年4月NVIDIA研究院《AI Grid分布式推理架构论文》arXiv:2604.02178)。

四、原理流程

AI Grid推理任务执行全流程分为4个步骤,端到端延迟最低可至12ms,具体流程如下:各步骤详细说明

- 任务提交:用户或应用通过API接入AI Agent编排框架,框架自动将不同格式的请求转换为标准化推理任务描述,包含模型类型、延迟要求、算力需求等参数

- 控制平面调度:控制平面接收标准化任务后,通过SRv6协议探测全网路径状态,结合网络切片资源占用情况,在1ms内完成任务到最优边缘节点的路由分配

- 硬件层执行:目标节点的BlueField-4 SuperNIC调用本地CUDA算力池执行推理任务,动态资源管理模块自动保障算力供给,执行完成后将结果回传至AI Agent框架

- 结果返回与编排:AI Agent框架对推理结果进行一致性校验,根据业务需求进行格式转换后,通过预留的网络切片通道返回给用户或应用

五、竞争格局分析

根据Gartner 2026年3月发布的《全球AI推理基础设施市场跟踪报告》(报告编号:G00798245),当前AI推理市场以集中式云服务为主导,2025年市场占比达87%,2026年全球AI推理市场规模预计达4200亿美元。AI Grid作为分布式推理方案的代表性产品,与主流竞品的核心差异及优劣势对比如下:核心差异化优势

- 深度集成电信网络:依托运营商现有基础设施实现广域低延迟覆盖,无需单独建网,部署成本仅为专用边缘推理方案的32%

- 硬件层专用优化:BlueField-4 SuperNIC针对推理场景做了指令集优化,算力利用率比通用GPU边缘部署方案高37个百分点

- 端到端自动化调度:从请求接入到结果返回实现全流程自动化,无需人工干预,运维成本比传统分布式方案降低62%

主要竞争对手对比

1. 云厂商集中式推理服务

- 代表产品:AWS SageMaker、Google AI Platform、Azure Machine Learning

- 技术路线:基于集中式云数据中心的推理服务,依赖远程计算和传输

- 核心优势:成熟生态、大规模算力集中管理、易于集成云服务、数据安全管控能力强、支持超大规模模型统一迭代

- 核心劣势:高延迟(跨区域边缘场景平均200ms+)、带宽成本高、广域边缘场景覆盖不足

2. 其他分布式推理方案

- 代表产品:边缘计算厂商定制方案、开源分布式推理框架

- 技术路线:基于边缘设备或专用硬件的分布式推理,缺乏电信网络原生集成

- 核心优势:低局部延迟、部署灵活、可适配特定场景定制化需求

- 核心劣势:广域覆盖范围小、标准化不足、生态碎片化、运维成本高

市场动态

当前AI推理市场保持68%的年增速,其中低延迟边缘推理需求占比从2023年的12%提升至2026年的38%,分布式推理成为关键增长方向。AI Grid通过与运营商合作的模式快速推进商用,预计2026Q3完成100+城市覆盖,假设合作运营商的边缘推理业务渗透率达到20%,可覆盖全球约8%的边缘推理需求;2027年若完成全球TOP50运营商的合作覆盖,且单运营商渗透率提升至40%,则预计可覆盖全球30%以上的边缘推理需求,推动网算融合成为AI基础设施的重要技术路线,与集中式云推理形成互补格局。六、关键判断

判断1:AI Grid是AI基础设施从集中式云侧向分布式网侧延伸的重要里程碑,可有效补充集中式推理的场景短板

- 置信度:高

- 重要性说明:实测对比AWS SageMaker集中式推理,可降低企业边缘推理场景成本64%,为运营商带来15%-20%的新增营收空间,同时可大幅降低低延迟AI应用的落地门槛,加速工业互联网、自动驾驶、AR/VR等场景的普及

- 行动建议:

- 有边缘推理需求的企业应尽快启动AI Grid试点评估,优先适配低延迟敏感业务

- 电信运营商可主动对接NVIDIA合作,提前布局边缘算力升级,获取新营收增长点

- AI开发者需适配分布式推理框架,可通过NVIDIA NGC平台提前接入全网分布式推理资源

判断2:NVIDIA通过AI Grid巩固在AI硬件和软件生态的领先地位,但面临云厂商和边缘计算对手的差异化竞争

- 置信度:中

- 重要性说明:市场竞争将推动分布式推理技术快速迭代,预计2027年单位推理成本相比2026年下降45%,最终惠及整个AI产业

- 行动建议:

- 持续跟踪NVIDIA与运营商的合作进展,重点关注100+城市商用部署的实际落地效果

- 关注云厂商推出的分布式边缘推理响应方案,以及边缘计算厂商的生态整合动作

七、待研究问题

- AI Grid的安全性和隐私保护机制细节如何?目前官方未披露数据传输、算力执行环节的加密方案及合规性认证情况

- 跨运营商网络互操作性和标准化进展?当前试点为单个运营商内部部署,跨网调度的技术标准、结算机制尚未明确

- 长期运维成本和可扩展性挑战?基于技术原理推断,大规模部署后全网节点的状态同步、故障恢复等运维成本可能大幅上升,尚无量化数据

- 对其他AI芯片厂商(如AMD、Intel)的潜在影响?当前AI Grid仅支持CUDA生态,后续是否开放其他芯片适配、对非NVIDIA算力的兼容性尚未公布

分析局限

本报告所有数据均来自NVIDIA官方发布的白皮书、技术论文及合作公告,第三方独立测试数据尚未公开,实际商用效果需待2026年第三季度规模部署后进一步验证。当前试点数据仅基于NVIDIA合作运营商样本,全球不同区域、不同发展阶段的运营商基站算力闲置率存在较大差异,实际落地效果可能与试点结果存在偏差。30%的2027年边缘推理需求覆盖预测基于“完成TOP50运营商合作、单运营商渗透率40%”的假设,存在不达预期的风险。战略重要性

定位: 生态扩张型,通过整合电信网络资源开辟新市场

核心因素: 核心壁垒:深度整合电信网络基础设施与CUDA算力生态,形成“网络+算力+调度”三位一体的闭环。通过SRv6、网络切片、BlueField-4硬件及CUDA动态复用技术,实现跨运营商边缘节点的毫秒级调度与资源高效利用。该壁垒强度高,短期内云厂商或边缘计算厂商难以复制其端到端的网络原生集成能力。

阶段判断: 过热期

决策选择

对厂商建议 (AWS、Google Cloud、Azure等云厂商,以及边缘计算方案商)

- 立即评估并推出或强化自身的“云网融合”边缘推理服务,如AWS Outposts/Wavelength,以应对低延迟场景分流。

- 针对NVIDIA CUDA生态锁定风险,加速投资或合作推广非CUDA生态的推理优化方案与开源框架。

下一步行动: 云厂商将加速与运营商合作,推出对标服务。

- 对延迟敏感(<100ms)的边缘AI应用(如质检、AR),启动小规模AI Grid概念验证,但需独立测试其SLA。

- 评估AI Grid多模型接入能力,规划将部分非核心、低延迟推理负载从云端迁移至边缘,以优化成本结构。

行动指引: 先导

对投资者建议

- 关注NVIDIA与运营商合作落地的实际进展(100+城市部署)及利用率数据,验证商业模式。

- 关注在跨网调度、边缘AI安全、异构算力管理等领域有技术积累的初创公司。

关键风险: 技术落地风险:实际性能与成本优势严重依赖运营商网络质量与算力闲置率,存在不及预期的可能。

预测验证

6个月 (高 置信度)

首批12家运营商试点将公布更多独立第三方测试数据,但性能数据可能较NVIDIA官方宣传有所折扣。

1年 (高 置信度)

主流云厂商将推出深度整合其云服务的运营商边缘推理方案,与AI Grid形成直接竞争。

2年 (中 置信度)

跨运营商网络互操作与结算标准将成为制约AI Grid大规模扩张的关键瓶颈,进展可能缓慢。

3年+ (中 置信度)

分布式推理将与集中式云推理形成稳定互补格局,占据约25-35%的边缘推理市场份额。

💬 评论 (0)