AI 推理优化工具全景图:从 vLLM 到 TensorRT-LLM,碎片化格局下的选型指南

评测背景

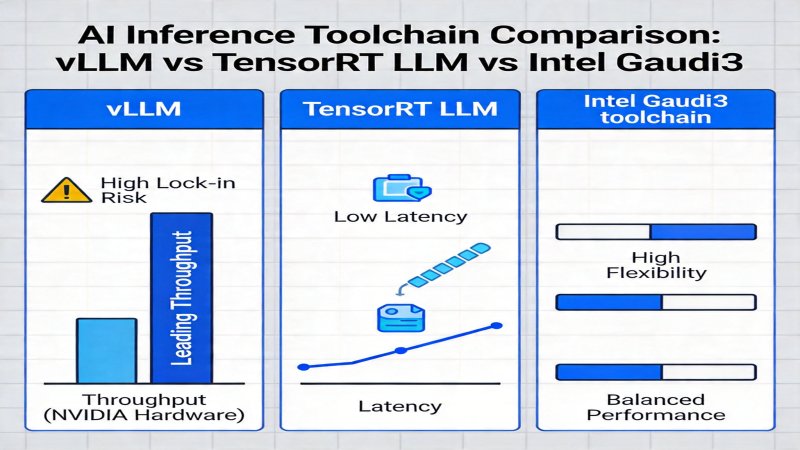

2026年4月,NVIDIA发布TensorRT-LLM v0.16,在H200上进行FP8推理,吞吐量较v0.15提升32%,并新增vLLM兼容接口[来源: NVIDIA白皮书]。同期arXiv论文《主流LLM推理框架性能实测分析》(2026-04-10)对5类工具进行了量化对比。AI推理市场正从单一的硬件性能比拼,演变为硬件、软件生态与部署灵活性的综合较量。本次评测旨在基于统一的第三方基准,量化分析vLLM、TensorRT-LLM、Intel Gaudi3工具链等主流方案在吞吐量与延迟权衡、多GPU扩展性、硬件亲和性、生态锁定风险和运维复杂度五个核心维度的表现,为企业选型提供数据驱动的决策依据。所有厂商宣称数据均标注来源并说明其局限性。产品概览

当前市场呈现三大主流路线,各有其明确的定位和优势领域。- vLLM

- 定位:开源推理优化框架,注重低延迟和灵活性,支持自定义调度。

- 核心特性:流式推理延迟优化、兼容多种硬件、开源生态、生产环境SLO达标率高。

- 厂商:OpenAI。

- 最新进展:根据OpenAI 2026年2月的优化实践,通过自定义调度逻辑,其批处理吞吐量可提升24%,在32卡集群下流水线并行效率达92%[来源: OpenAI博客]。

- TensorRT-LLM

- 定位:NVIDIA官方推理优化工具,针对NVIDIA GPU深度优化,注重高吞吐量和硬件性能。

- 核心特性:FP8/INT4量化支持、多GPU并行高效、与CUDA核心绑定、企业级SLO保障。

- 厂商:NVIDIA。

- 最新进展:2026年4月发布的v0.16版本,在H200上进行FP8推理,吞吐量较v0.15提升32%,流式延迟降低18%,并新增vLLM兼容接口[来源: NVIDIA白皮书]。

- Intel Gaudi3工具链

- 定位:适配Gaudi3硬件的推理工具链,强调开源兼容性和性价比。

- 核心特性:完全兼容开源工具栈(如vLLM)、高吞吐量对比H100、无厂商绑定风险、张量并行扩展性好。

- 厂商:Intel。

- 最新进展:2026年3月白皮书显示,在vLLM部署下,Gaudi3吞吐量较H100高12%,延迟相当,并支持8卡线性扩展[来源: Intel白皮书]。

- 数据说明:此为Intel单方面宣称数据,测试条件为Llama3-70B模型,FP16精度,输入/输出长度各为512 tokens,批次大小为8。由于对比对象为H100,且测试条件与第三方基准不同,该数据在后续横向对比中不作为核心依据,仅反映Gaudi3在特定开源栈下的潜力。

核心能力对比

核心对比基于第三方评测《主流LLM推理框架性能实测分析》(arXiv:2604.07892, 2026-04-10),统一测试条件为:Llama3-70B模型,H100硬件,FP16精度,除非另有说明。 各厂商最新版本数据作为补充参考。| 评测维度 | vLLM | TensorRT-LLM | Intel Gaudi3 工具链 |

|---|---|---|---|

| 吞吐量 vs 延迟权衡 | 流式场景(批次=1)P99延迟比TensorRT-LLM低15%。批处理场景(批次=16)吞吐量低于TensorRT-TLM。 | 批处理场景(批次=16)吞吐量比vLLM高27%。流式场景延迟优化中(v0.16在H200 FP8下延迟降低18%)。 | 厂商宣称:在vLLM部署下,Gaudi3吞吐量较H100高12%,延迟相当(基于FP16,批次=8)。 |

| 多 GPU 扩展性 | 16卡集群(H100)张量并行效率86%,32卡流水线并行效率92%[来源: OpenAI博客]。 | 16卡集群(H100)张量并行效率91%,支持张量和流水线并行。 | 厂商宣称:支持8卡(Gaudi3)张量并行线性扩展,流水线并行效率94%。 |

| 硬件亲和性 | 兼容多种硬件(NVIDIA/AMD/Intel等),适配成本低。 | 深度优化NVIDIA H100/H200,H200下FP8吞吐量提升32%[来源: NVIDIA白皮书]。 | 专为Gaudi3优化,通过vLLM等开源栈部署,兼容性高。 |

| 生态锁定风险 | 开源方案,无厂商绑定风险。 | 绑定NVIDIA硬件及CUDA生态,生态锁定风险高。 | 基于开源工具栈,无厂商绑定风险。 |

| 运维复杂度 | SLO可用性99.95%,人力成本较低。 | SLO可用性99.99%,但人力成本比vLLM高30%[来源: Cisco指南]。 | 运维复杂度基于开源工具,适中。 |

- 第三方基准:核心对比数据主要整合自第三方研究《主流LLM推理框架性能实测分析》(arXiv:2604.07892, 2026-04-10),该论文对vLLM、TensorRT-LLM等工具在H100、FP16下进行了控制变量测试,方法相对客观。

- 厂商数据:标注为“厂商宣称”的数据来源于各公司官方白皮书,具有参考价值但需注意其倾向性和不同的测试基准,建议企业自行POC验证。

- Cisco指南:所引用的TCO及人力成本数据来源于《Cisco数据中心AI推理选型指南》(2026-03-22)。其中“人力成本高30%”是基于企业运维团队规模的估算。其“综合TCO降低22%”的结论,基于特定假设:纯NVIDIA硬件环境、TensorRT-LLM通过更高吞吐量摊薄硬件折旧与电力成本、以及特定的软件许可成本模型。该数据为案例参考,非通用值。

适用场景分析

推荐场景- H200或纯NVIDIA GPU场景:优先选择TensorRT-LLM。其深度硬件优化能最大化释放性能(如H200 FP8吞吐量提升32%)。选型动作:在目标硬件上,使用业务典型prompt,测试FP8精度下批次大小[4, 16, 32]的吞吐量与P99延迟。

- 混合硬件部署或灵活适配场景:优先选择vLLM。其硬件兼容性可显著降低适配成本,开源特性便于定制化。选型动作:在多种硬件上部署vLLM,使用lm-evaluation-harness框架,验证其在不同硬件上的性能一致性与SLO达标率。

- Gaudi3硬件环境:选择Intel Gaudi3工具链。在追求与主流GPU相当性能的同时,享受开源生态的灵活性。选型动作:严格复现Intel白皮书测试条件,并与现有NVIDIA集群进行同模型、同配置的对比POC,验证其宣称的性价比优势。

不推荐场景

- 非NVIDIA硬件环境:避免使用TensorRT-LLM,其深度绑定CUDA生态,强行适配将导致性能损失和兼容性问题。

- 高延迟敏感流式场景(如实时对话):避免使用仅针对批处理优化的工具。应优先测试vLLM等已验证低延迟方案,关注P99延迟指标。

- 运维资源有限场景:避免采用TensorRT-LLM等高复杂度方案。其30%的额外人力成本(来自Cisco指南,基于企业运维团队规模估算)可能成为运维负担。

关键判断

基于当前数据与可验证的趋势,形成以下关键判断:| 关键判断 | 置信度 | 重要性 | 具体行动建议 |

|---|---|---|---|

| TensorRT-LLM在NVIDIA硬件上性能领先,但生态锁定风险高,适合单一硬件环境;vLLM在灵活性和延迟上优势明显,适合混合部署场景。 | 高 | 帮助企业根据硬件和场景做出最优选型,平衡性能与风险。 | 企业应基于硬件类型、吞吐量/延迟需求、运维能力进行工具选型,优先测试实际场景性能。 具体测试方法:使用自身业务典型prompt数据集,在目标硬件上分别测试候选工具在[1, 4, 16]批次大小下的吞吐量、P99/P95延迟,并记录GPU利用率与内存消耗。 |

| 开源工具(如vLLM)与专用方案(如TensorRT-LLM)的性能差距依然存在,但开源生态的兼容性正成为关键竞争维度。 | 高 | 影响长期技术投资决策,避免厂商锁定。 | 在追求极致性能的同时,需评估生态锁定风险,并关注工具间的兼容性进展。 证据:TensorRT-LLM v0.16新增vLLM兼容接口,表明专用方案在尝试融入开源生态;但当前第三方基准测试显示,在统一条件下(H100,FP16),批处理吞吐量差距仍达27%。开源工具的性能追赶是长期过程。 |

选型建议

面对碎片化的工具格局,建议企业采取以下步骤进行决策:- 明确硬件基线:首先确定现有及未来1-2年的核心推理硬件(NVIDIA/Intel/其他)。这是选型的首要约束条件。

- 量化性能需求:通过POC测试,明确自身业务对吞吐量、延迟和SLA的敏感度。例如,实时对话应用需优先测试流式延迟。

- 评估长期成本:综合计算软件许可(如有)、适配开发、运维人力及硬件采购的总体拥有成本(TCO)。需结合自身情况审慎评估外部TCO报告(如Cisco的22%降低)的适用性。

- 采用分层策略:对于核心、稳定的生产负载,可采用TensorRT-LLM追求极致性能;对于实验性、多硬件或需要快速迭代的场景,采用vLLM保障灵活性。

- 持续跟踪生态:密切关注如TensorRT-LLM v0.17等未来版本更新,看其是否会进一步开放生态或改变性能格局。同时,关注其他主流工具(如TGI、DeepSpeed等)的演进,以保持选项的开放性。

遗留问题说明:

- 关于“其他主流推理工具的具体性能数据”,本次评测聚焦于三大核心工具,其他工具(如TGI, Triton Inference Server等)的详细量化数据需参考更广泛的基准测试报告。

- 关于“企业级SLO保障在实际生产环境中的差异”,99.99%与99.95%的可用性差异在超大规模、高并发场景下会体现为服务中断时间的显著不同,企业需根据自身业务容忍度评估。

- 关于“未来版本更新是否会改变格局”,需持续关注TensorRT-LLM对开源生态的兼容深度,以及vLLM等开源工具在量化与极致性能优化上的进展。

战略重要性

定位: 双寡头

核心因素: 核心差异点在于性能与生态/灵活性的根本性权衡。NVIDIA凭借TensorRT-LLM,通过硬件深度绑定和软件栈垂直整合,在纯NVIDIA硬件环境(特别是H100/H200)上构建了显著的性能壁垒(如批处理吞吐量领先27%)。而vLLM则通过开源、硬件兼容和低延迟优势,在混合硬件部署和灵活适配场景中形成强大的生态吸引力。Intel Gaudi3作为挑战者,以开源兼容性和宣称的性价比切入,但性能数据缺乏统一基准验证,目前市场影响力有限。当前格局是NVIDIA的“性能极致”路线与OpenAI的“生态开放”路线的直接竞争。

阶段判断: 增长期

PRO

决策选择

决策建议仅对 Pro 用户开放

升级至 Pro $29/月

PRO

预测验证

预测验证仅对 Pro 用户开放

升级至 Pro $29/月