事件:6公司AI合同的采购架构解读

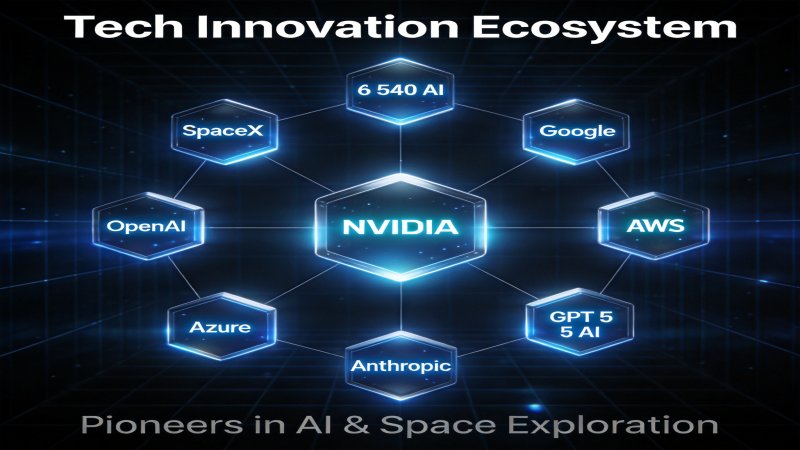

2026年5月1日,美国国防部正式宣布与六家科技公司签署具有里程碑意义的AI集成协议,合同总规模高达540亿美元。这六家公司分别是:Google、OpenAI、NVIDIA、AWS、Microsoft和SpaceX。这一消息在AI行业和国防领域引发强烈反响,因为它标志着美国军方首次系统性地将AI能力整合进其核心作战和情报体系。

从采购架构来看,这份合同并非简单的技术采购,而是一份精心设计的垂直整合AI栈合同。国防部并未选择单一的AI解决方案供应商,而是根据AI技术栈的不同层级选择了不同的专业供应商:

- SpaceX:提供卫星通信和全球连接能力

- NVIDIA:提供AI训练和推理的核心算力

- AWS/Azure:提供云基础设施和分布式计算

- Google/OpenAI:提供AI模型能力

这种分层采购策略确保了国防部不会被任何单一厂商锁定,同时能够利用每家厂商在其专业领域的最佳能力。

垂直整合AI栈:从卫星到模型的每一层

第一层:SpaceX的全球连接层

SpaceX在Pentagon AI Stack中扮演的角色远超传统承包商。Starlink卫星网络为AI系统提供了无处不在的低延迟全球连接能力。在现代战争中,情报的实时传输和边缘计算能力至关重要。SpaceX的卫星网络使AI系统能够在全球任何角落运行,无论是在数据中心还是战场边缘。

这一能力对于"分布式AI作战"至关重要:

- 战场边缘AI:在卫星覆盖的任意地点部署AI推理能力

- 实时态势感知:传感器数据通过Starlink实时传输至AI分析系统

- 弹性通信:即使部分地面基础设施被摧毁,AI系统仍能通过卫星保持连接

第二层:NVIDIA的算力层

NVIDIA在Pentagon AI Stack中的地位不可替代。作为AI训练和推理的核心算力供应商,NVIDIA的GPU是所有先进AI模型的底层基础。从GPT-5.5到Claude Mythos,这些模型的训练都依赖于NVIDIA的H100和B200系列GPU。

五角大楼选择NVIDIA的原因包括:

- 技术领先性:NVIDIA在AI训练和推理领域的领先地位无可争议

- CUDA生态:NVIDIA的CUDA生态系统提供了最完善的AI开发工具链

- 安全合规:NVIDIA已通过美国政府的多项安全认证

- 供应链可控:作为美国本土公司,NVIDIA能够确保供应链安全

第三层:AWS/Azure的云基础设施

AWS和Microsoft Azure共同提供了Pentagon AI Stack的云基础设施层。这两家公司的作用包括:

- 分布式计算:为AI训练和推理提供可扩展的计算资源

- 数据管理:处理和存储来自各类传感器的海量数据

- 安全隔离:提供满足军事安全要求的隔离计算环境

- 全球覆盖:在世界各地部署数据中心,确保AI系统的低延迟访问

国防部选择同时使用AWS和Azure,而非单一供应商,反映了其对供应商多样性和韧性的重视。

第四层:Google/OpenAI的模型层

Google和OpenAI被选中提供AI模型能力,这是Pentagon AI Stack中最具战略价值的层级。这两家公司的模型能力代表了当前AI技术的最前沿:

- OpenAI:GPT-5.5系列模型,特别是GPT-5.5-Cyber在网络安全领域的专项能力

- Google:Gemini系列模型,在多模态理解和长上下文处理方面具有优势

值得注意的是,这两个模型最近的网络安全能力突破(TLO测试)是五角大楼做出采购决策的底层驱动力之一。能够通过复杂网络入侵测试的AI模型,意味着它们具备在网络攻防作战中发挥作用的能力。

Google的8年转变:从Maven抗议到军事AI

Google在2026年签署这份军事AI合同,标志着该公司与美军关系的根本性转变。回顾历史,这一转变来之不易:

2018年:Project Maven风波

2018年,Google参与美国国防部Project Maven项目(使用AI分析无人机监控视频)引发内部强烈抗议。数千名员工联署公开信,要求Google立即终止与军方的任何AI合作。最终,Google承诺不续签Project Maven合同,并在2019年发布了AI伦理准则,明确限制AI武器化的应用。

转折点:Anthropic的"空位"

随着Anthropic因拒绝自主武器和大规模监控而被排除在五角大楼AI供应链之外,Google看到了填补这一空白的战略机会。同时,OpenAI虽然在技术上领先,但在道德争议方面同样面临质疑。Google认为,通过展示负责任的军事AI应用,它可以在国家安全和AI伦理之间找到平衡点。

2026年:正式签约

Google与五角大楼的新合同明确规定了AI使用边界:

- 禁止用于致命性自主武器决策

- 限制在目标识别和态势分析等非致命性任务

- 所有AI决策需保留人类监督

- 建立独立的AI伦理审查委员会

这一转变反映了大型科技公司在商业利益和伦理立场之间的复杂博弈。对于Google而言,失去国防部合同的机会成本可能高达数十亿美元。

Anthropic出局:道德立场的商业代价

Anthropic被排除在五角大楼AI合同之外,是本期分析中最具争议的决定。Anthropic明确表达的立场使其成为AI伦理的"代言人",但也付出了沉重的商业代价。

Anthropic的伦理框架

Anthropic的AI伦理立场可以概括为以下核心原则:

- 拒绝自主武器:Claude不应被用于做出或支持致命性使用武力的决策

- 反对大规模监控:AI系统不应被用于无差别的大规模公民监控

- 可解释性要求:军事AI系统的决策过程必须具备可解释性

- 人类主导:在生命攸关的军事决策中,AI应始终处于人类监督之下

商业代价

Anthropic的道德立场带来的代价是具体的:

- 540亿美元合同:Anthropic完全被排除在外

- 战略锁定风险:被排除在国防部AI供应链之外,可能导致其技术路线与主流国防生态渐行渐远

- 人才吸引力变化:一部分开发者可能因为Anthropic的道德立场而更愿意加入,但也有投资者因为商业前景受限而持保留态度

战略选择

Anthropic的CEO Dario Amodei多次公开表示,公司愿意接受"道德立场带来的商业代价"。这一表态既是价值观的宣示,也是商业战略的定位——Anthropic正在成为"负责任AI"的品牌代表,吸引那些同样重视AI伦理的企业和机构。

这种"伦理溢价"策略的长期效果仍有待观察。短期内,Anthropic可能在民用AI市场找到替代增长路径;但长期而言,如果军事AI成为AI行业最大的收入来源之一,Anthropic的立场可能面临越来越大的商业压力。

概率模型在确定性系统中的根本挑战

Pentagon AI Stack面临一个根本性的技术哲学问题:如何在依赖确定性的军事系统中部署概率性的AI模型?

概率模型的本质局限

现代AI模型,包括GPT-5.5和Claude Mythos,都是基于概率统计的语言模型。这意味着:

- 输出不确定性:相同的输入可能产生不同的输出

- 幻觉风险:AI可能生成看似合理但实际错误的信息

- 对抗脆弱性:精心设计的输入可能导致AI产生意外输出

在民用场景中,这些局限可能带来不便;但在军事场景中,它们可能带来灾难性后果。

生命攸关系统的特殊要求

军事和国防系统对可靠性的要求远超民用系统:

| 要求 | 民用AI系统 | 军事AI系统 |

|---|---|---|

| 响应时间 | 秒级可接受 | 毫秒级需求 |

| 可靠性 | 99%可接受 | 99.999%需求 |

| 可解释性 | 最好有 | 必须有 |

| 失败后果 | 用户体验下降 | 生命代价 |

| 验证标准 | 市场检验 | 政府认证 |

当前解决方案

五角大楼的应对策略是"人类在环"(Human-in-the-Loop)模式:

- AI提供分析建议,人类保留最终决策权

- AI输出需经过人类审查才能执行

- 关键决策完全排除AI介入

这种方法在短期内是务实的,但它也限制了AI系统在实际作战中的效用。如果AI的建议总是需要人类验证,那么AI加速决策的优势将大打折扣。

技术进步方向

解决概率模型与确定性系统矛盾的技术方向包括:

- 可解释AI:提高AI决策过程的透明度,使人类能够更好地理解和验证AI的建议

- 置信度校准:让AI准确表达其对输出正确性的置信度,从而人类可以据此决定是否采纳

- 对抗鲁棒性:提高AI模型对抗恶意输入的抵抗力

- 混合架构:将概率AI与传统规则系统结合,在高风险场景中优先依赖确定性规则

对AI行业格局的深层影响

国防AI市场的大门正式打开

540亿美元的Pentagon合同不仅是迄今为止最大的AI政府采购合同,更重要的是它建立了国防AI采购的框架和标准。这个框架将影响未来所有国防AI合同的设计。

分层采购成为标准:五角大楼的分层采购策略可能成为国防AI采购的标准范式。其他国家和地区的国防部门可能效仿这种模式。

合规要求成为门槛:Anthropic的出局表明,AI厂商的伦理立场可能成为进入国防市场的门槛。这将迫使AI厂商在商业利益和伦理立场之间做出明确选择。

AI军备竞赛进入新阶段

Pentagon AI Stack的建立标志着AI军事化从理论走向实践。其他国家可能被迫加速自己的国防AI计划,以应对美国的技术优势。

地缘政治影响:

- 中国可能加大AI军事化投入

- 欧洲可能发展独立的国防AI能力

- 小国可能寻求通过AI非对称优势弥补常规军事差距

行业整合加速

540亿美元的大合同将加速AI行业的整合:

- 赢家通吃:进入国防供应链的AI厂商将获得稳定的收入来源和宝贵的实战数据

- 淘汰加速:被排除在国防市场之外的AI厂商可能面临更大的生存压力

- 并购活跃:国防AI领域的并购活动将显著增加

战略建议

对AI厂商

已签约厂商(Google/OpenAI/NVIDIA/AWS/Microsoft/SpaceX):

- 投资建立专门的国防合规团队

- 开发符合军事AI伦理要求的产品功能

- 探索"负责任军事AI"的品牌定位

未签约厂商(特别是Anthropic):

- 评估国防市场的长期战略价值

- 寻找民用AI市场的替代增长路径

- 建立"伦理AI"品牌差异化

对企业决策者

- 关注国防AI技术向民用市场的溢出效应

- 评估AI供应链的地缘政治风险

- 准备应对AI军事化带来的监管和合规变化

对投资者

- 国防AI供应商将获得显著的估值溢价

- "AI+国防"可能成为下一个热门投资主题

- 关注政策风险,特别是国际AI军事化可能引发的监管反应

Pentagon AI Stack的建立是AI发展史上的分水岭事件。它不仅开启了国防AI市场的大门,更重塑了AI厂商的战略选择空间。在这场新的AI军备竞赛中,技术能力、商业利益和伦理立场之间的平衡将成为决定胜负的关键变量。

战略重要性

540亿美元的五角大楼AI合同不仅是迄今为止最大的AI政府采购,更标志着AI军事化从理论走向实践。这份合同建立了国防AI采购的框架和标准,将影响未来所有相关采购。SpaceX到OpenAI的垂直整合代表了AI作战体系的新范式。Anthropic的出局表明道德立场正在成为市场准入的隐性门槛。概率AI模型在确定性军事系统中的适用性挑战,可能催生新一代可解释AI和混合架构技术。

决策选择

AI厂商决策:已签约厂商需投资国防合规团队,建立军事AI伦理要求的产品功能。Anthropic等未签约厂商需评估国防市场长期价值,建立"伦理AI"品牌差异化。

企业决策者决策:关注国防AI技术向民用市场的溢出效应。评估AI供应链的地缘政治风险。准备应对AI军事化带来的监管变化。

投资者决策:国防AI供应商将获得显著估值溢价。"AI+国防"可能成为下一个热门投资主题。关注政策风险和国际AI军事化可能引发的监管反应。

预测验证

未来12个月内,其他国家将宣布类似的国防AI采购计划。GPT-5.5和Claude Mythos的能力将持续迭代,五角大楼可能将AI攻击能力纳入供应商资质审核。可解释AI和混合架构技术将成为投资热点。Anthropic可能在民用市场找到替代路径但面临长期增长天花板。

💬 评论 (0)